Beschreibung

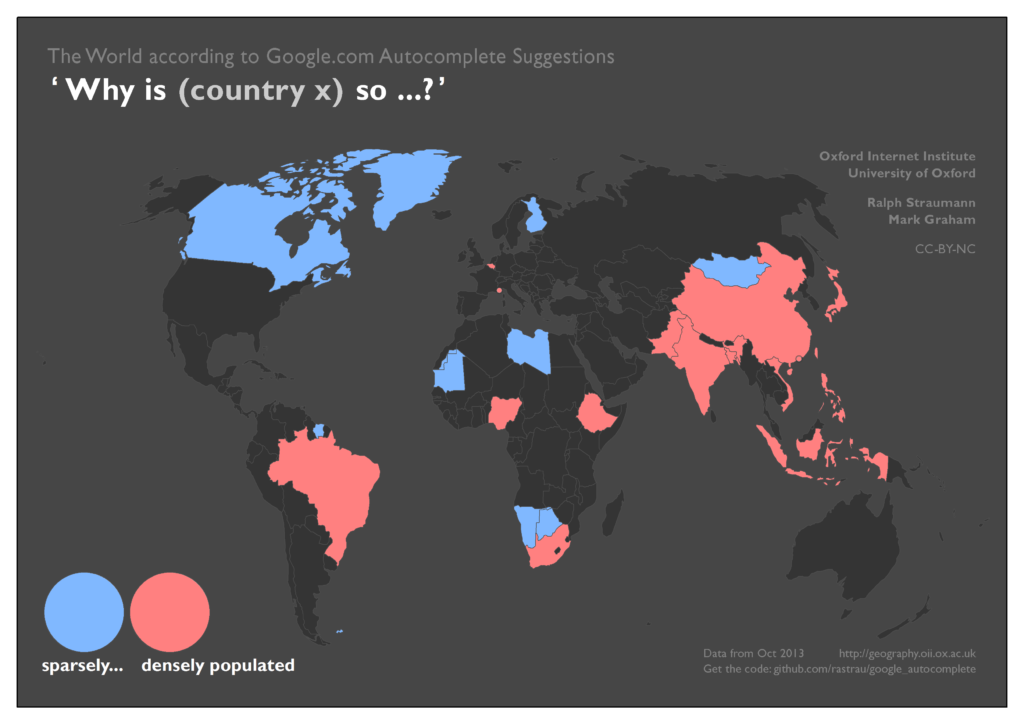

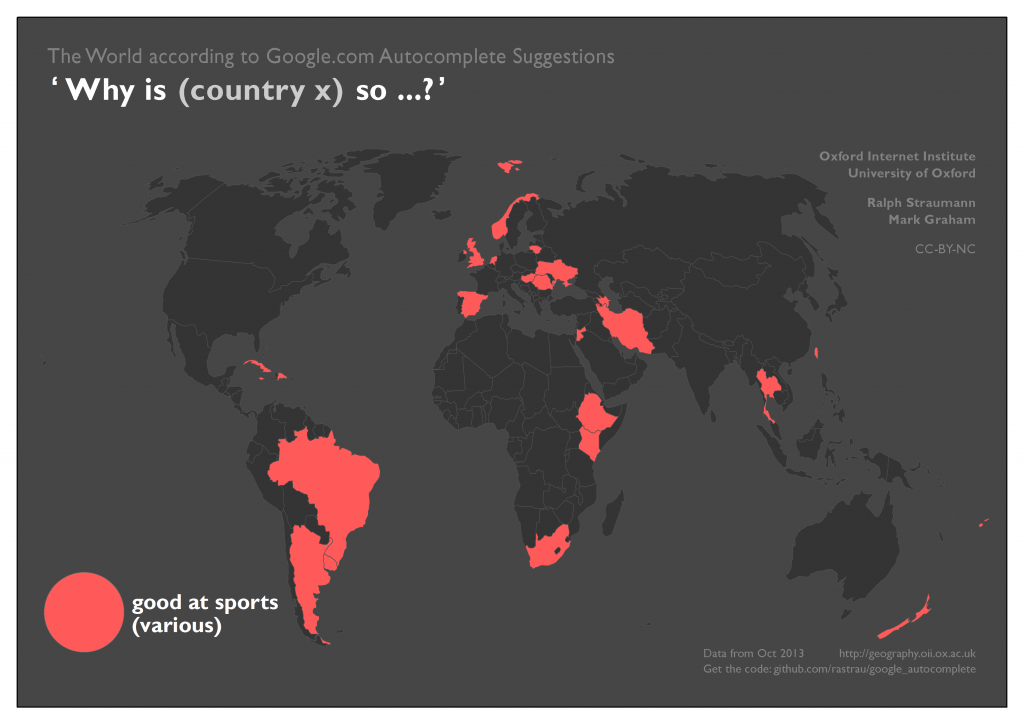

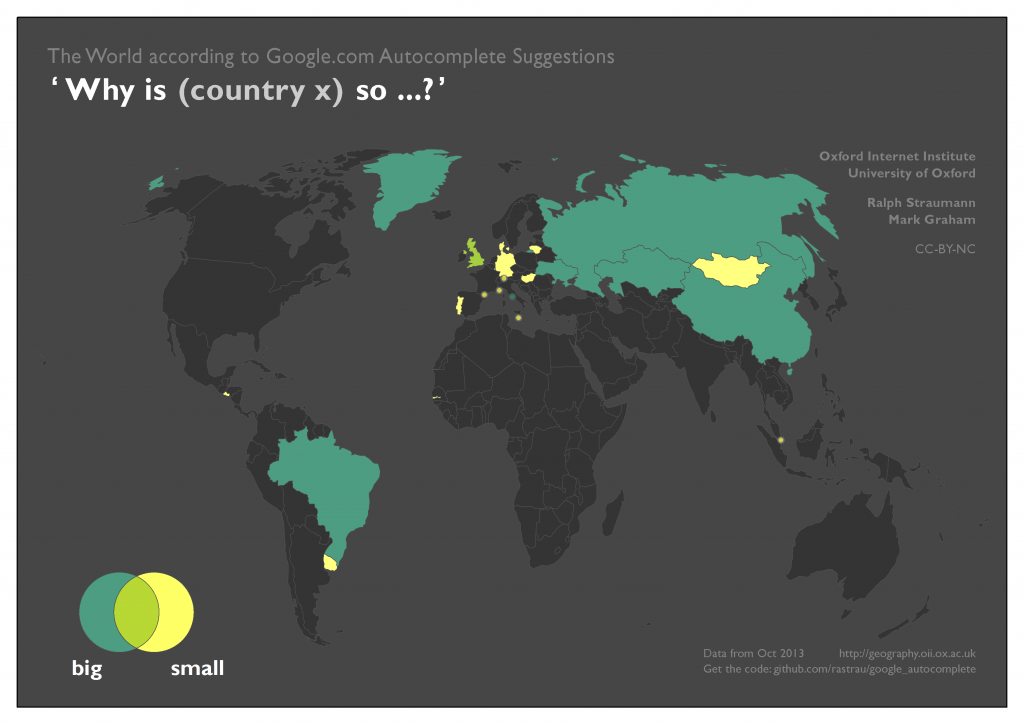

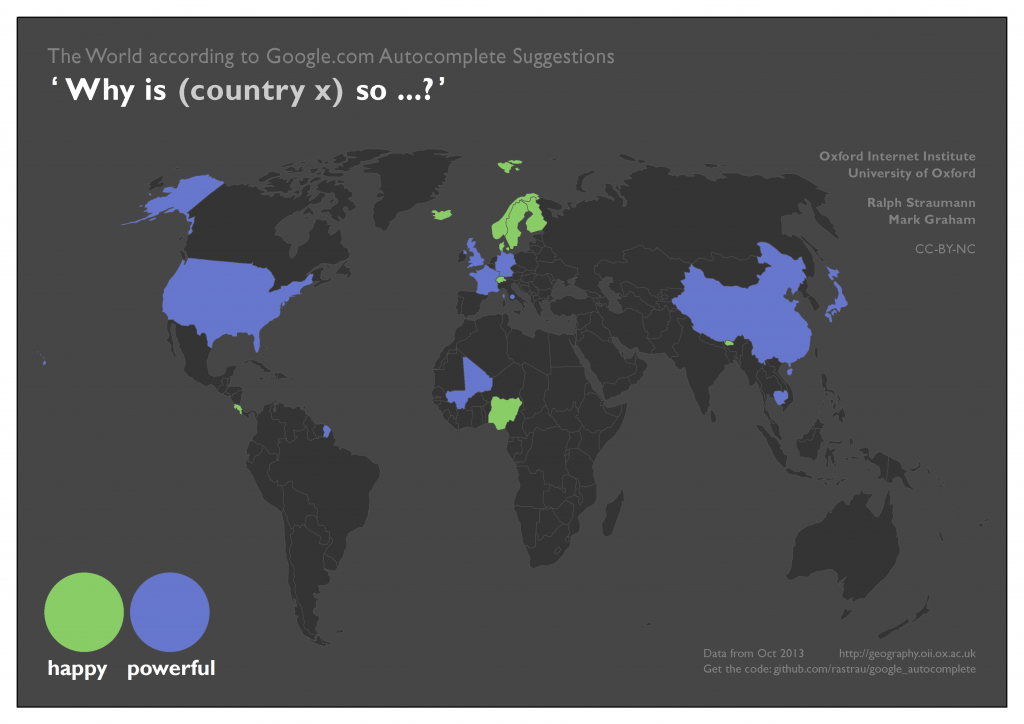

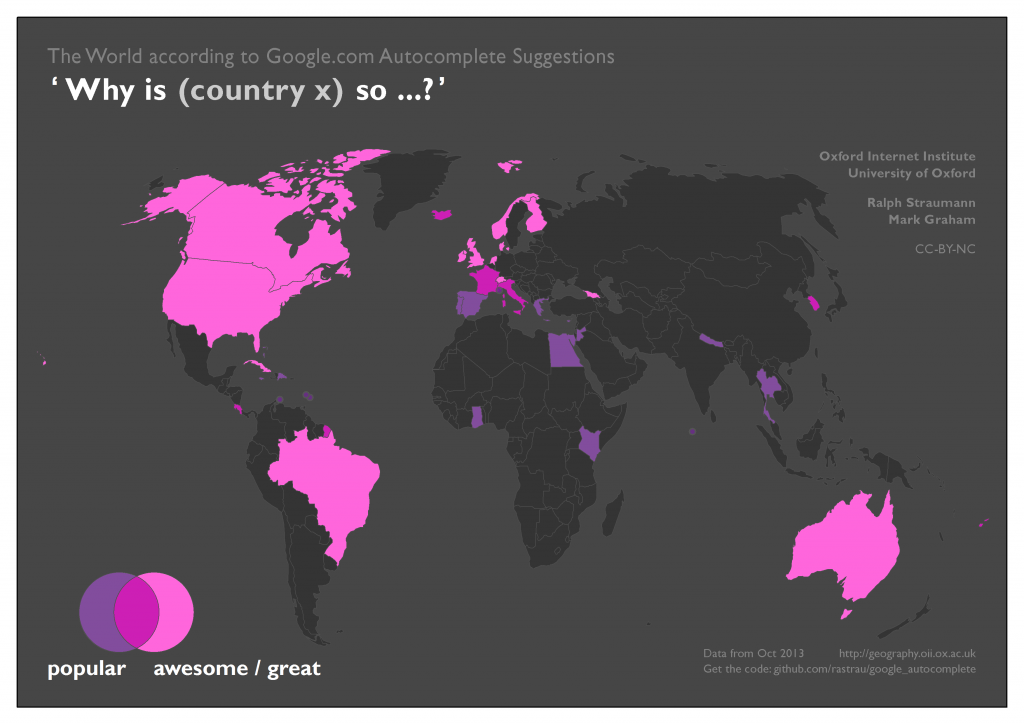

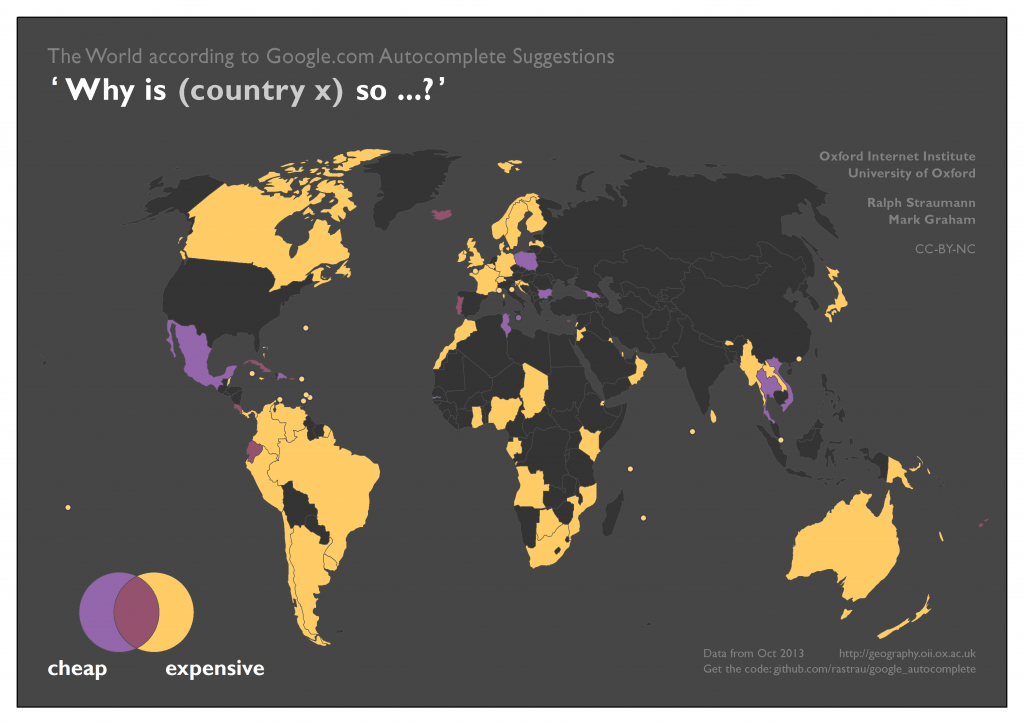

Diese Karte zeigt, was Googles Autocomplete-Funktion in verschiedenen Ländern vorschlägt, wenn man die Frage „Warum ist (Land x) so …“ eingibt. Diese Ergebnisse bieten einen Einblick über Google, sowie die Präferenzen von Millionen Internet-Nutzer. Zusammengestellt wurden verschiedene Karten zu einer Reihe von Themen: physische, wirtschaftliche, soziodemographische und teilweise etwas skurrile Anfragen.

Daten

Viele große Technologie-Unternehmen haben Algorithmen für die Bereitstellung von Abfragevorschläge, basierend auf der Eingabe Suchfeldern und/oder unmittelbare Rückmeldung der Benutzer, entwickelt. Diese Techniken werden gemeinhin als „Autosuggest“, inkrementelle Suche oder Autovervollständigung bezeichnet. Googles Autocomplete stützt sich auch auf den Google-Index des Web, nicht nur auf das, was die Nutzer suchen bzw. eingeben. Zusätzlich werden die Autocomplete-Ergebnisse auch für die Suche des Benutzers in der Vergangenheit auf der Basis angeboten, wenn der Benutzer angemeldet und die Web-History-Funktion aktiviert ist, und auf Benutzerprofildaten von Google+. Mit einem Python-Skript wurde Google.com für alle Länder mit dem folgenden Satz abgefragt: „Warum [ ist / sind ] [der ] (Land x ), so .“ Ein Beispiel: „Warum ist Kenia so „, „Warum sind die Philippinen so“, „Warum ist das Vereinigte Königreich so“ etc. Die Formulierung dieser etwas naive Abfrage soll widerspiegeln, was Leute bemerkenswert, interessant, traurig, ärgerlich, überraschend finden oder ihnen einfach unbekannt über ein Land ist. Die Ergebnisse, die wir von Google.com erhalten zeigen weiter, dass die Daten der Autocomplete-Vorschläge wahrscheinlich größtenteils von NutzerInnen aus der westlichen Hemisphäre stammen und somit wahrscheinlich die Informationssuchenden in anderen Teilen der Welt nicht ausreichend repräsentieren.

Vor der Kartierung wurden die abgerufenen Daten gereinigt. Ergebnisse, die zu einem Kategorienfehler, die aufgrund einer Mehrdeutigkeit des Ländernamen resultierten, wurden ganz entfernt. Ein semantisches Problem: die Türkei (turkey) lieferte Antworten wie „hoch in Natrium „, „gut für Sie“, “ teuer in diesem Jahr“. Diese semantischen Fehlpaarungen wurden aus den Daten entfernt .

Aussage

Google sagt uns, wonach wir suchen sollten. Der Konzern betont, dass die Autocomplete-Vorhersagen algorithmisch bestimmt werden – ohne jegliche menschliche Intervention. Darüber hinaus ist die Menge an Nutzerdaten (und damit der Trainingsdatenmenge) von Google Autocomplete so massiv weil sie direkt in die Websuche integriert und damit nicht deaktivierbar für die NutzerInnen ist. Google kann keine Autocomplete-Suchbegriffe vorschlagen, die unpopulär sind oder die Abfrage im Bereich von Suchanfragen die im Bereich der „Pornografie, Gewalt, Hassreden und Urheberrechtsverletzungen“ angesiedelt werden anzeigen. Trotz dieser Erklärungen und Regulierungsversuche hat Google die Autocomplete-Funktion Gerichtsverfahren und Klagen in verschiedenen Ländern beschert. Vor kurzem war Googles Autocomplete-Funktion Anlaß für eine Kampagne der UN Women. Auf den Plakaten und Bannern werden Google Autocomplete-Anfragen wie „Frauen können nicht“ oder „Frauen sollten“, zu lesen, um Sexismus und Diskriminierung von Frauen, die sowohl in unserer Gesellschaft, als auch in technischen Informationsumgebungen vorhanden sind, zu demonstrieren.

Obwohl wir keine Möglichkeit haben, die Black Box Googles Autocomplete-Algorithmus zu öffnen, können wir ein kleines Bild der regionalen Unterschiede durch die Abbildung der Autocomplete-Ergebnisse erhalten.

Dem Anspruch an einen neutralen Suchprozess wird durch Autocomplete noch stärker von der Suchmaschine selbst gesteuert. Google lenkt uns, indem es uns noch während der Eingabe massenkonforme Sucheingaben vorschlägt. Ein „Mainstreaming“ von Inhalten wird dadurch begünstigt. nach dem Motto: Was viele suchen, muß morgen schneller gefunden werden. Dennoch nehmen wir diese Funktion scheinbar dankbar an.

http://geography.oii.ox.ac.uk/?page=the-world-through-the-eyes-of-a-search-algorithm

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC

Quelle: Marc Graham & Ralph Straumann – CC-BY-NC